Murasaki 4B v0.3

Collection

Murasaki-4B v0.3的全量权重与量化版本合集 • 2 items • Updated

System 2 Reasoning Model for ACGN Translation

Github | Benchmark | BF16 Version | License: CC BY-NC-SA 4.0

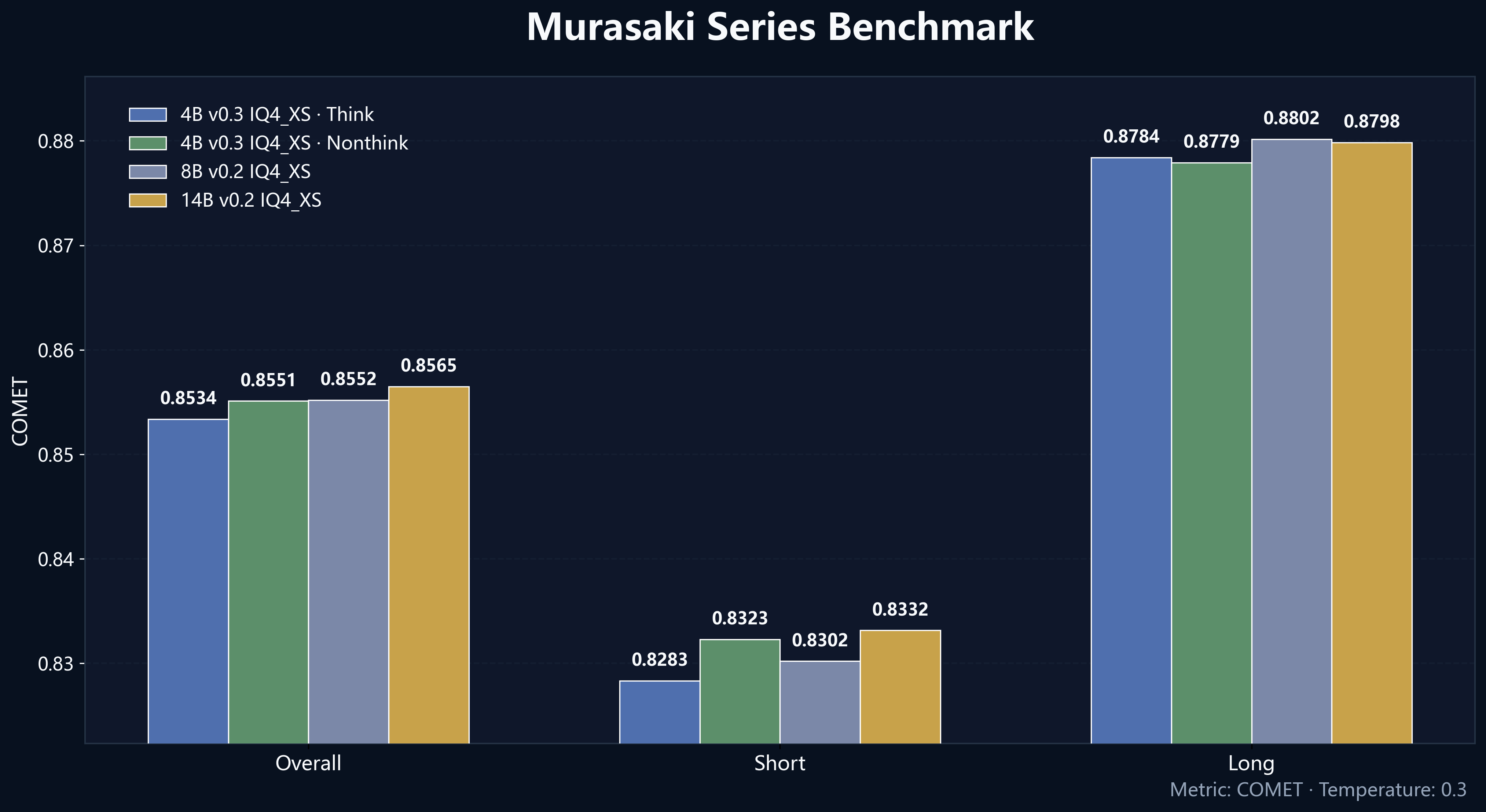

Murasaki 系列模型是专为轻小说、Galgame等 ACGN 领域训练的 System 2 推理型日中翻译模型。

这是 v0.3 系列的第一个模型,也是我们训练的首个4B参数的模型。相较于前代,我们在训练方法上进行了多项改进,并首次引入了基于 Prompt 的逻辑开关,支持自主选择是否开启显式思维链(CoT)输出。

在技术实现上,我们针对 Non-think(非思考)模式 进行了专项能力迁移:通过基于隐藏层向量对齐的加权 Loss 策略及思维链逐步压缩,尝试将深度推理能力内化至直接输出阶段。

实验证明,该方法使 Non-think 模式的译文表现显著优于未经混合训练的同类模型,在部分保留思维链的能力的同时优化了首字延迟(TTFT)与推理速度。

注:具体的 Prompt 文本请参考 BF16 版本介绍页面

✨ Now Live: 无需下载模型,点击 Online Demo 在线体验模型。

| 文件名 | 量化方法 | 文件大小 | 推荐显存 | 适用场景 |

|---|---|---|---|---|

Murasaki-4B-v0.3-Q6_K.gguf |

Q6_K | 3.63 GB | 6GB+ | 推荐:高精度首选 |

Murasaki-4B-v0.3-Q5_K_M.gguf |

Q5_K_M | 3.16 GB | 6GB | 平衡性能 |

Murasaki-4B-v0.3-Q4_K_M.gguf |

Q4_K_M | 2.72 GB | 4GB+ | 经典量化 |

Murasaki-4B-v0.3-IQ4_XS.gguf |

IQ4_XS | 2.48 GB | 4GB | 推荐:性价比最优 |

Murasaki-4B-v0.3-IQ3_M.gguf |

IQ3_M | 2.13 GB | 4GB | 极低配置运行 |

为了获得最佳的翻译体验,请使用我们配套开发的开源前端翻译 GUI (v2.2.0 以上版本): 👉 Murasaki Translator (GitHub)

./llama-cli -m Murasaki-4B-v0.3-IQ4_XS.gguf \

-p "[你是一位精通中日双语的资深ACGN翻译家...]" \

-n 2048 \

-t 8 \

--temp 0.3 \

-c 8192

0.1 - 0.5 (推荐 0.3)1.0 开始,如出现复读可增加至 1.05 - 1.12048 或更高(思考模式需要留出空间给 <think> 标签内容)Copyright © 2026 Murasaki Project

3-bit

4-bit

5-bit

6-bit

Base model

Murasaki-Project/Murasaki-4B-v0.3